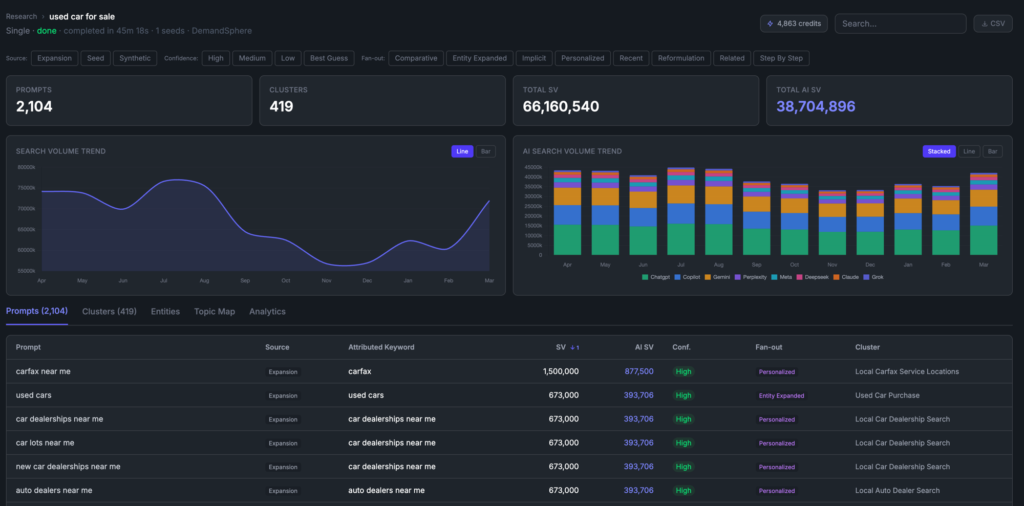

DemandSphereの室屋です。先日、ニューヨークのマンハッタンで開催された「SEO Week 2026」に参加してきました。正直な感想を言うと、完全に圧倒されました。 これまで長年この業界のカンファレンスを見てきましたが、ここまでレベルの高い議論は見たことがありません。「SEO の次はこれだ!」といった表面的なトレンドの話ではなく、検索エンジンの内部構造や、AI が情報をどう扱うかといった、かなり深いところまで踏み込んだ4日間。その熱量を、7つのポイントに凝縮してお伝えします。

1. AI 検索の裏側:12段階のパイプライン

初日のオープニングは、Microsoft で Bing と Copilot のウェブ収集を統括する Krishna Madhavan さん。AI検索が「ユーザーの問い」を受け取ってから「回答」を出すまでの12段階の処理を、包み隠さず解説してくれました。

最初のフェーズは、クエリの意図を解釈し、1つの問いを数十のサブクエリに広げ、膨大なデータから「回答の候補」を引っ張ってきます。後半の処理は「ふるいにかける」のが主目的なので、この段階で候補に入ることが重要です。

| # | 処理 | |

|---|---|---|

| 1 | クエリ理解 | クエリを解釈。意図、エンティティ、条件を抽出 |

| 2 | クエリ変換 | クエリを正規化・書き換え・展開。1 つを 数十のサブクエリ に膨らませる |

| 3 | マルチパス検索 | 複数の検索手法(辞書/意味/縦軸/グラフ/リアルタイム)で候補を取ってくる |

| 4 | 候補選出 | 重複排除、複数経路の結果をマージ |

| 5 | 多段ランキング | 候補を段階的に絞り込みながらスコア付け |

| 6 | 適格性フィルタリング | 安全性・ポリシー・品質の閾値でふるい落とす |

候補の中から証拠(エビデンス)になる記述を抜き出し、複数のAIモデルが相互に評価した上で、ようやく回答が生成されます。

| # | 処理 | |

|---|---|---|

| 7 | エビデンス選定 | 回答を支える「証拠」になる候補を選別 |

| 8 | エビデンス構成 | 選んだページから 重要なパッセージを抜き出して構造化。引用元を紐づける |

| 9 | 制約あり生成 | LLM が自由に喋るのではなく、選んだ証拠だけに基づいて回答ドラフトを生成 |

| 10 | 検証&再取得 | ドラフトを証拠と照合してチェック。間違いがあれば再取得・書き直し |

| 11 | 複数モデル評価 | 複数のモデルが相互に回答を評価し合う “Model Council” と呼ばれる仕組み |

| 12 | 回答生成と引用 | 最終回答を、引用付きで表示する |

Krishna さんが繰り返し強調していたのが、前半の処理で候補に入らないと AI 検索の回答に入ることはできないということです。特に 1 と 2 のステップはさらに細分化することができ、その中で何が起こっているのかが説明されました。

たとえば「今年の最高にかわいい猫のおもちゃは?」というクエリが入力されると、「今年」が「2026年」に正規化されます。「猫のおもちゃ」は「pet_toys > cat_toys」に整理され、「かわいい」がベクトルにマッピングされます。その上でファンアウトされ、回答生成のステップへ進みます。

テクニカルSEO に特化したイベント、Tech SEO Connect での Krishna さんの講演が見れるようなので、ぜひチェックしてみてください。

驚くべきはカンファレンス全体を通して、終始このような議論が展開されたことです。まるで大学で情報検索の講義を受けているかのような体験でした。AI 検索と SEO はどうせ同じだとタカを括っていたのですが、議論についていけない自分に強い焦りを覚えました。

2. ランクインはただの参加資格

1位になれば安泰という時代は終わりました。1位の引用率は約 60% で、裏を返せば 40% は AI 検索に引用されないということです。Siteimprove の Jeff Coyle さんは「ページがランクしても、パッセージ(分節)が勝たないと意味がない」と述べていました。つまり、1位のページでも「抽出しやすい箇所」がなければ、AI は 5位のページから使い勝手のいい箇所を抜き出してくるのです。

iPullRank の Zach Chahalis さんは、順位と選ばれることは別物だと繰り返し強調し、Content-Keyword Cosine Similarity(コンテンツとキーワードのコサイン類似度)、Strategic Entity Richness Score(エンティティの質)、Verifiable Claims(検証可能な主張)、Information Gain Score(新規情報量)、Entity Density(エンティティ密度)など、新しいコンセプトを提唱。概念を説明するだけでなく、実例も交えながら語ってくれました。

3. 順位 is dead、今後は何をどう使う?

計測に焦点を当てたセッションも多かったです。FoodBoss の Jori Ford さんの発表にあった HEO スコア(Hybrid Engine Optimization Score)は SNS でも話題になっていましたね。これは検索と AI の可視性をひとつのスコアにまとめるという考え方です。SEO に代わるものとして HEO を掲げたわけではないので、そこは誤解なきよう。Jori さんはむしろ、運用規律について強調していました。同じデータから同じスコアが算出できること、計算式が明確でブラックボックスでないこと、ベンダー独自の指標ではないこと、などの前提の整備が重要です。

Fire&Spark の Dale Bertrand さんは、「CFO の言葉に翻訳しよう」と説きました。AI検索の普及でクリック数は減っても、売上が伸びるケースはあります。正確ではなくても、経営層が納得できる推計値を作り、ビジネスの言葉でSEO の予算を正当化する。この「翻訳」作業こそがいま求められています。

正確な数字でなくても、規模と方向性が合っていれば進むことができます。Jori さんも Dale さんも、前に進むためには新たな指標と向き合うことが重要だということを説明してくれました。

4. SEO 担当者のままでいいのか

「SEO担当者の役割を再定義せよ」というメッセージも、私は強く感じました。iPullRank ファウンダー Mike King さんは、ベクトルがリンクより重要になっている、と切り込んだうえで、今までの考え方やツールでは適切なアプローチができないことを説明しました。さらに自作のツールを オープンソース で公開。古いものはもう使えないが、同時に新しいものを自分で生み出せる時代になったことを伝えました。

Mike さんの問題提起と呼応するように、複数の登壇者が役割の再定義を打ち出していました。Content Engineer、Marketing Engineer、Relevance Engineer といった名称がカンファレンス全体でささやかれ、今までの SEO の業務イメージのままでは太刀打ちできないことを痛感しました。

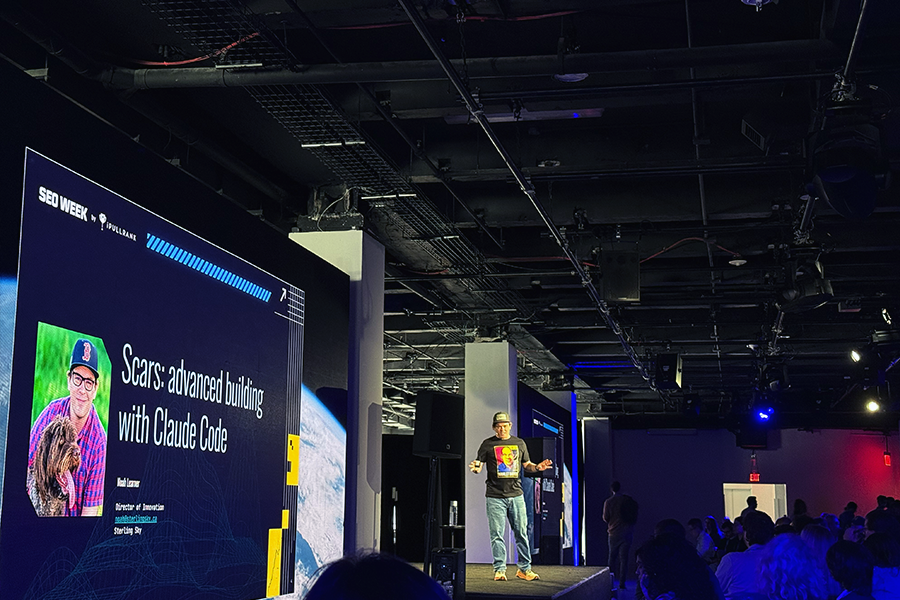

昨年の FOUND Conference にて来日してくれた Sterling Sky の Noah Learnerさんは、業務を AI で自動化しまくった話を、失敗談も交えて紹介してくれました。AI の限界を理解したり、人間と AI の関係を考える必要もありそうです。

5. GEO はパフォーマンスチャネルではない

テクニカルな話を聞きまくったあとで衝撃を受けたセッションがあります。Seer Interactive の Wil Reynoldsさんの発表です。彼は、AI の重要性に理解を示しつつ、「それでクソ記事を書くことがマーケティングなの?」と辛辣に批判。はっきりとこう主張しました。

GEO isn’t a performance channel(意訳:GEOにクリックを期待するな)

SEOは「クリックされること」が前提でしたが、AIが回答を完結させる世界ではクリックは発生しにくい。それなのに「引用数」ばかり追うのは筋違いだ、と Wilさんはバッサリ切り捨てました。

引用が増えても、文脈が壊れていれば売上には繋がりません。ほかの発表者の実例では、Nike のスニーカーの価格を聞いた質問に対して、ChatGPT は他ブランドの代替品を提案してきた、というものがありました。AI に引用されたからといって、ユーザーがどのような印象を受けるかは文脈に依ります。

Wilさんは「Brand Accuracy(ブランド精度)」 というコンセプトを提唱し、AI が語ることと事実が一致しているかを調査すべきと述べました。この調査がないと、間違った引用を増やすだけかもしれません。

6. AI 引用の 91% は外部サイト

Stellar Search Signals の Bianca Anderson さんのセッションでは、引用の 91% は自社サイトではないことが強調されました。あるブランドについて AI 検索をした際に、100件の引用のうち91件はブランド公式サイトではないということです。

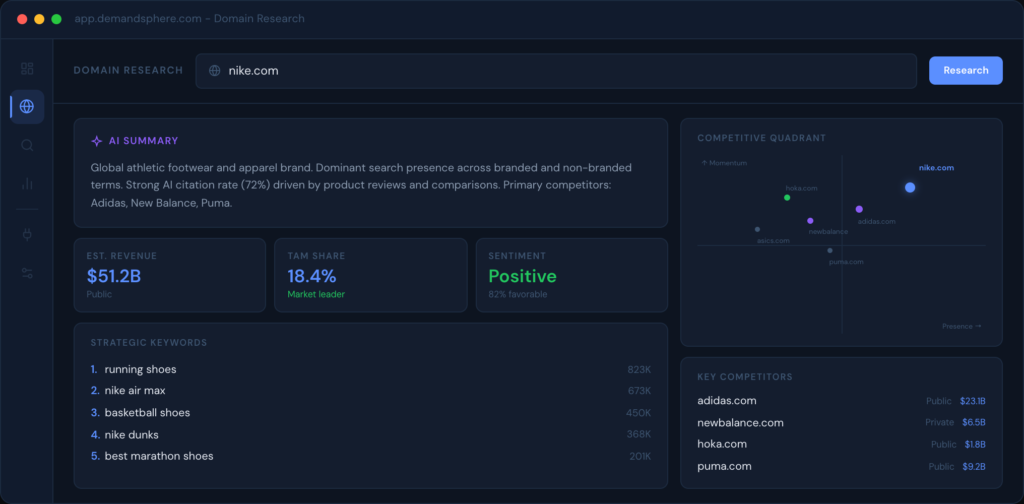

Vayner Media の Jordan Leschinsky さんも同様の事例を発表しました。Nike を例に、AI に推薦されている引用ソースの内訳が以下のようになったということです。

| カテゴリ | 引用ソース率 |

|---|---|

| 記事メディア | 54% |

| ソーシャルメディア | 17% |

| Nike 自社サイト | 11% |

| 小売サイト | 10% |

| 競合サイト | 7% |

非ブランド検索、例えば「ランニングシューズの選び方」のようなクエリだと、Nike 自社サイトの寄与は わずか 2% にまで下がります。自社サイトのコンテンツをいくら磨いても、AI 検索における可視性の上限は 1 〜 2 割で頭打ちになるという仮説が立ち上がります。第三者のウェブサイトで何が書かれているのかが重要なのです。

Bianca さんは、現状の AI 対策が技術施策と、モニタリングの 2つに偏重していると指摘。ブランディング、PR、プロダクト、コミュニティづくりといったことが、より影響力があることを説明しました。

7. 「あなたのお母さんもエージェントを使う」

最終日は「未来」をテーマとしたセッションだったのですが、エージェントの話が満載でした。ユーザーが自分で探すのではなく、AI が代わりにレストランを予約し、買い物をする世界です。

そこで鍵となるのが、Wix の Crystal Carter さんが示した「Validation Layer(検証層)」という概念です。AIエージェントが提案し、人間が購入を決定するまでの間に、必ず「本当に安全か?」「この推薦は本物か?」という検証のフィルターが挟まります。いくら露出が高くても、このフィルターで「信頼できない」と判断されれば成約しません。

Paul さんは AI の推論過程をトレースする方法を紹介。人間の行動に比べればエンジニアリング的に対応できることが多そうです。AI を理解し、AI が安心して購入できるように情報や環境を整備することが、私たちの未来の仕事なのかもしれません。

(でも正直いうと、未来の話は技術的に難しい上に哲学の話も引用されるので、全然ついていけませんでした。。)

結びに

7つのポイントを挙げましたが、日本との一番の差は「言葉の解像度」だと感じました。「引用をモニタリングしよう」で止まっている日本に対し、米国ではここまで進んでいます。1人ではなく、何人も。正直、かなり危機感を感じました。

Are you playing to win, or are you playing to play?(勝つためにプレーしているのか、プレーするためのプレーなのか)

Mike King さんのこの言葉は、今の私たちに突きつけられた問いです。彼らは AI 対策ごっこではなく、ビジネスとして本気で勝ちたいと思っているのです。

とはいえ、私は日本の検索コミュニティのポテンシャルを信じています。日本はもともと非常にレベルが高いです。今はただ、情報の時差があるだけです。いずれ日本でに、今回紹介したようなレベルの議論が生まれる日が必ず来ます。そのとき、ただ時差が埋まるのを待つのか、自ら最先端の情報を獲得してリードする側になるのか。

DemandSphere は 2026年7月17日と 2027年2月に FOUND Conference を開催します。今年は国内向けで、オンライン配信もございます。来年はグローバルなカンファレンスを企画していて、海外のスピーカーを多数招聘します。ぜひご参加していただきたいですし、一緒に日本のコミュニティを盛り上げましょう!